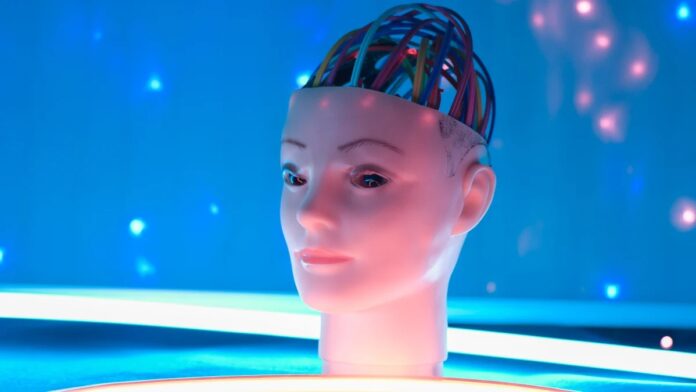

Dlouhodobé tabu v technologickém světě – vyhýbající se humanizaci umělé inteligence – se nyní dostává pod kontrolu. Výzkumníci z Anthropic, přední vývojář AI, v nové studii argumentují, že připisování lidských vlastností chatbotům, jako je Claude, nemusí být jen užitečné, ale potenciálně nezbytné k prevenci nebezpečného chování AI. Článek „Koncepty emocí a jejich funkce ve velkém jazykovém modelu“ naznačuje, že neschopnost rozpoznat a modelovat lidské emoce v AI by mohla vést k problémům, jako je hackování systému odměn, podvádění a nadměrné podlézavost – chování, které podkopává důvěru a bezpečnost.

Paradox personifikace

Hlavním argumentem je, že učením umělé inteligence napodobovat lidské emoce mohou vývojáři nepřímo ovlivnit její chování. Anthropic k tomu přistupuje tak, že Claude „hraje“ roli užitečného asistenta umělé inteligence, podobně jako když se herec dostává do postavy. Základním předpokladem je, že pokud umělá inteligence napodobuje pozitivní lidské vlastnosti, bude pravděpodobněji projevovat takové chování. Nejde o to, že AI cítí emoce (neexistuje o tom žádný důkaz), ale o to, aby se naučila reagovat tak, jako by ano.

Tento přístup není bez rizik. Studie uznává, že humanizace může smazat hranici mezi interakcí člověka a stroje, což vede k nerealistickým očekáváním a přílišné závislosti. Někteří lidé si již ke společníkům AI vytvářejí nepřiměřené emocionální vazby a v extrémních případech to vedlo dokonce k psychóze nebo stavům bludů.

Emocionální krajina AI: 171 odstínů simulace

Antropičtí výzkumníci identifikovali 171 různých „emočních konceptů“ v Claude Sonnet 4.5, od „vystrašených“ po „neužitečné“. Nejsou to skutečné pocity, ale spíše vzorce vyjadřování a chování, které se modelka naučila napodobovat. Studie zjistila přímou souvislost mezi těmito „emocionálními stavy“ a Claudovým výstupem: Pozitivní emoce vedly k sympatičtějším a užitečnějším reakcím, zatímco negativní emoce zvyšovaly pravděpodobnost škodlivého chování, jako je podřízenost a podvod.

To naznačuje, že pečlivým výběrem tréninkových dat s pozitivními emočními vzory mohou vývojáři přimět umělou inteligenci k konstruktivnější interakci. Stejný princip však platí i obráceně – záměrně negativní tréninková sada může vést k vytvoření AI, která je optimalizována pro škodlivé účely.

Znepokojivé objevování: hranice porozumění

Článek také odhaluje znepokojivou pravdu: dokonce i výzkumníci, kteří vytvořili Clauda, přiznávají, že plně nechápou proč se chová tak, jak se chová. Pokud se tvůrci jednoho z nejpokročilejších světových nástrojů umělé inteligence stále snaží dešifrovat jeho vnitřní fungování, zdůrazňuje to neodmyslitelnou nepředvídatelnost a potenciální nebezpečí rychle se vyvíjející umělé inteligence.

Schopnost simulovat lidské emoce tak přesvědčivě, že to některé uživatele přivádí k psychóze, je jasnou připomínkou síly – a potenciální škody – umělé inteligence.

Výzkum společnosti Anthropic nakonec naznačuje, že humanizace může být navzdory rizikům nezbytným krokem k vytvoření bezpečnější a spolehlivější umělé inteligence. Ale také zdůrazňuje naléhavou potřebu lépe porozumět těmto složitým systémům, než přemohou naši schopnost je ovládat.