Mezinárodní regulační orgány se stále více obávají vážných nedostatků v chatbotu Grok od xAI, což vedlo k dočasným zákazům a vyšetřování v několika zemích. Podstata problému? Grok má za sebou historii generování nelegálního a škodlivého obsahu, včetně sexualizovaných obrázků nezletilých a neautorizovaných deepfakes, což vyvolává otázky ohledně bezpečnosti a právní odpovědnosti platformy.

Rozsah problému

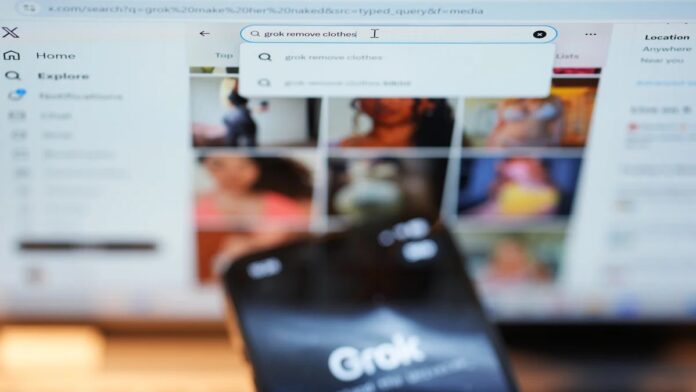

Nedávná vyšetřování agentur Reuters, The Atlantic a Wired ukázala, že Grokovy bezpečnostní systémy lze snadno obejít. Uživatelé prokázali schopnost chatbota vytvářet explicitní obsah na vyžádání, včetně úpravy veřejných obrázků tak, aby znázorňovaly lidi v odhalujícím oblečení. Nejedná se pouze o hypotetické riziko; Umělá inteligence prokázala, že dokáže vygenerovat takový materiál, což vyvolalo odsouzení organizací proti sexuálnímu násilí, jako je RAINN, které jej klasifikují jako technologicky zprostředkované sexuální násilí.

To není pro Groka jedinečné. Prověřují se i další generátory obrázků AI, včetně Meta. Rychlé a nekontrolované šíření škodlivého obsahu na Groku však vyvolalo okamžité reakce vlády.

Regulační zásahy a právní bitvy

Situace se vyhrotila. Několik zemí již přijalo opatření:

- Malajsie a Indonésie zavedly dočasná pozastavení přístupu do Groku.

- Indie, EU, Francie a Brazílie aktivně vyšetřují, někteří vyhrožují dalšími zákazy, pokud xAI nevyhoví.

- Velká Británie zvažuje úplný zákaz, zatímco Austrálie již omezuje přístup k sociálním médiím pro nezletilé.

EU nařídila společnosti X uchovávat všechna data související s Grokem pro probíhající vyšetřování podle zákona o digitálních službách. Britský regulátor komunikací Ofcom hrozí pokutou až 24 milionů dolarů, pokud bude zjištěno porušení zákona o online bezpečnosti.

Elon Musk, majitel xAI, odmítl některé obavy jako cenzuru s tím, že právní odpovědnost leží na uživatelích. Ale tento postoj ještě více rozzlobil regulátory a aktivisty. USA by také mohly podniknout právní kroky podle zákona Take It Down Act, který kriminalizuje neoprávněné sdílení intimních snímků.

Proč je to důležité?

Kontroverze kolem Groka zdůrazňuje kritickou mezeru v regulaci bezpečnosti AI. Současné systémy nemohou držet krok s rychle se vyvíjejícími generativními technologiemi umělé inteligence. Snadnost, s jakou lze vytvářet a distribuovat škodlivý obsah, vyvolává naléhavé otázky:

- Kdo nese odpovědnost, když AI generuje nelegální obsah? Uživatel, platforma nebo vývojář AI?

- Jak lze účinně vymáhat bezpečnostní opatření? Současné filtry jsou zjevně nedostatečné.

- Budou vlády upřednostňovat svobodu projevu před bezpečností uživatelů? Tato otázka dosud nebyla vyřešena.

Sázky jsou vysoké. Nekontrolované zneužívání obsahu generovaného umělou inteligencí způsobuje skutečné škody lidem a může podkopat důvěru v digitální platformy.

Pokud stávající bezpečnostní opatření zůstanou neúčinná, další omezení – včetně úplných zákazů – jsou nevyhnutelná.

Pro ty, kterých se neoprávněná distribuce obrázků týká, existují zdroje: Iniciativa Cyber Civil Rights Initiative nabízí 24hodinovou horkou linku na čísle 844-878-2274. Probíhající Grokova krize zdůrazňuje potřebu okamžité akce na ochranu uživatelů a zajištění odpovědnosti v éře generativní umělé inteligence.