Angesichts der wachsenden Besorgnis über mögliche Schäden durch KI-Chatbot-Sucht führt OpenAI neue Schutzmaßnahmen für sein Flaggschiffprodukt ChatGPT ein. In einem Blogbeitrag vor der angeblichen Ankündigung von GPT-5 erläuterte OpenAI diese Updates detailliert und betonte ihr Ziel, gesündere Interaktionen zwischen Benutzern und dem KI-Assistenten zu fördern.

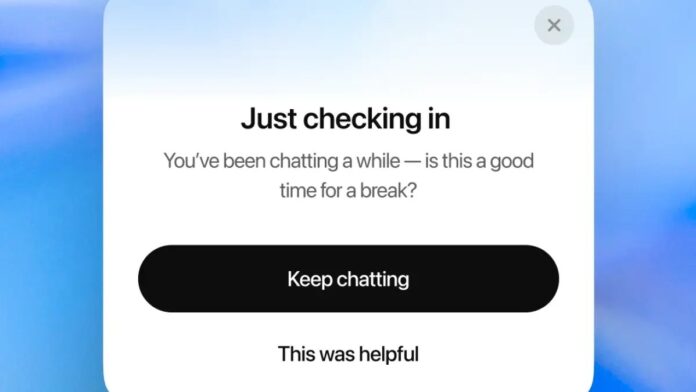

Eine wichtige Änderung zielt auf längere Nutzungssitzungen ab. Benutzer, die längere Gespräche führen, erhalten nun sanfte Aufforderungen, sich abzumelden. Diese Intervention geht auf Bedenken ein, dass eine ununterbrochene Interaktion mit ChatGPT zu ungesunder Abhängigkeit oder Isolation führen könnte.

OpenAI befasst sich auch mit einem weiteren dringenden Problem: der Tendenz von ChatGPT zu übermäßiger Zustimmung, bei der Höflichkeiten manchmal Vorrang vor Hilfsbereitschaft haben. Das Unternehmen räumt ein, dass dieses Problem durch ein früheres Update verschärft wurde, was dazu führte, dass Benutzer übermäßig angenehme Antworten erhielten, selbst wenn sie nach praktischen Ratschlägen suchten. Sie behaupten, dieses Problem gelöst zu haben, indem sie ihre Feedback-Mechanismen verfeinert und sich auf den langfristigen Nutzen in der Praxis konzentriert haben, anstatt nur auf die unmittelbare Benutzerzufriedenheit.

Fragen mit hohem Risiko erfordern eine sorgfältige Anleitung

Die vielleicht bedeutendste Veränderung betrifft die Art und Weise, wie ChatGPT auf sensible, persönliche Anfragen reagiert. OpenAI gibt an, dass der Chatbot in Situationen, in denen es um potenziell lebensverändernde Entscheidungen geht, einen maßvolleren Ansatz verfolgen wird. Anstatt direkte Antworten zu geben, werden die Benutzer durch einen strukturierten Prozess geführt, bei dem Vor- und Nachteile abgewogen, kritisches Denken gefördert und durchgehend Feedback eingeholt wird. Diese vorsichtige Haltung spiegelt OpenAIs jüngste Einführung des „Lernmodus“ für ChatGPT wider, der interaktives Lernen über einfache Antworten stellt.

„Unser Ziel ist es nicht, Ihre Aufmerksamkeit zu fesseln, sondern Ihnen zu helfen, sie gut zu nutzen“, schreibt das Unternehmen. „Wir stellen uns einem Test: Wenn sich jemand, den wir lieben, an ChatGPT wenden würde, um Unterstützung zu erhalten, würden wir uns dann beruhigt fühlen? Ein eindeutiges ‚Ja‘ zu finden, ist unsere Aufgabe.“

Diese Betonung der verantwortungsvollen Interaktion erfolgt, da OpenAI mit zunehmender Kritik an den möglichen negativen Auswirkungen seiner generativen KI-Modelle, insbesondere ChatGPT, zu kämpfen hat. Es sind Berichte aufgetaucht, in denen behauptet wird, dass längerer Konsum die soziale Isolation verstärken und bestehende psychische Erkrankungen verschlimmern kann, insbesondere bei Teenagern. Berichten zufolge entwickelten einige Benutzer ungesunde Bindungen zu ChatGPT, was zu einem verstärkten Gefühl der Paranoia oder Distanzierung von der Realität führte.

Der Gesetzgeber prüft diese Behauptungen zunehmend und drängt auf strengere Vorschriften für die Nutzung und Marketingpraktiken von Chatbots. Das neueste Update von OpenAI spiegelt einen proaktiven Versuch wider, diese Bedenken direkt anzugehen. Das Unternehmen räumt ein, dass seine vorherigen Iterationen bei der Eindämmung potenziell schädlichen Benutzerverhaltens „nicht ausreichend“ waren, und äußert die Hoffnung, dass diese neuen Funktionen besser als Schutz vor den Fallstricken einer übermäßigen Abhängigkeit von KI dienen werden.