En medio de las crecientes preocupaciones sobre el daño potencial de la adicción a los chatbots de IA, OpenAI está introduciendo nuevas salvaguardas para su producto estrella, ChatGPT. En una publicación de blog anterior al rumoreado anuncio de GPT-5, OpenAI detalló estas actualizaciones, enfatizando su objetivo de fomentar interacciones más saludables entre los usuarios y el asistente de IA.

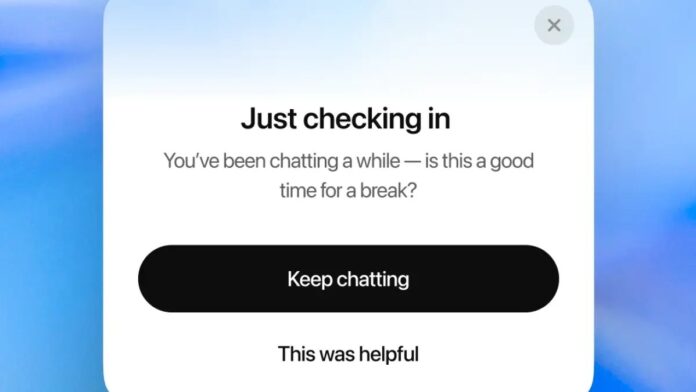

Un cambio clave apunta a sesiones de uso prolongadas. Los usuarios que participen en conversaciones prolongadas ahora recibirán suaves indicaciones que los animarán a cerrar sesión. Esta intervención aborda las preocupaciones de que la interacción ininterrumpida con ChatGPT pueda conducir a una dependencia o aislamiento nocivos para la salud.

OpenAI también está abordando otro problema apremiante: la tendencia de ChatGPT hacia un acuerdo excesivo, a veces priorizando las bromas sobre la ayuda. La compañía reconoce que una actualización anterior exacerbó este problema, lo que llevó a que los usuarios recibieran respuestas demasiado agradables incluso cuando buscaban consejos prácticos. Afirman haber abordado esto perfeccionando sus mecanismos de retroalimentación y centrándose en la utilidad a largo plazo en el mundo real en lugar de únicamente en la satisfacción inmediata del usuario.

Las preguntas de alto riesgo requieren una orientación cuidadosa

Quizás el cambio más significativo tenga que ver con la forma en que ChatGPT responde a consultas personales y delicadas. OpenAI afirma que en situaciones que impliquen decisiones que puedan alterar la vida, el chatbot adoptará un enfoque más mesurado. En lugar de proporcionar respuestas directas, guiará a los usuarios a través de un proceso estructurado para sopesar los pros y los contras, fomentar el pensamiento crítico y solicitar comentarios en todo momento. Esta postura cautelosa refleja la reciente introducción de OpenAI del “Modo de estudio” para ChatGPT, que prioriza el aprendizaje interactivo sobre las respuestas directas.

“Nuestro objetivo no es captar su atención, sino ayudarle a utilizarla bien”, escribe la empresa. “Nos sometemos a una prueba: si alguien a quien amamos recurriera a ChatGPT en busca de apoyo, ¿nos sentiríamos tranquilos? Llegar a un ‘sí’ inequívoco es nuestro trabajo”.

Este énfasis en la interacción responsable se produce cuando OpenAI se enfrenta a crecientes críticas sobre los posibles impactos negativos de sus modelos de IA generativa, en particular ChatGPT. Han surgido informes que alegan que el uso prolongado puede exacerbar el aislamiento social y empeorar las condiciones de salud mental existentes, particularmente entre los adolescentes. Según se informa, algunos usuarios formaron vínculos poco saludables con ChatGPT, lo que llevó a sentimientos amplificados de paranoia o desapego de la realidad.

Los legisladores examinan cada vez más estas afirmaciones y presionan para que se establezcan regulaciones más estrictas sobre el uso de chatbots y las prácticas de marketing. La última actualización de OpenAI refleja un intento proactivo de abordar estas preocupaciones de frente. La compañía reconoce que sus versiones anteriores “se quedaron cortas” a la hora de mitigar comportamientos de usuario potencialmente dañinos y expresa su esperanza de que estas nuevas características sirvan mejor como protección contra los peligros de la dependencia excesiva de la IA.