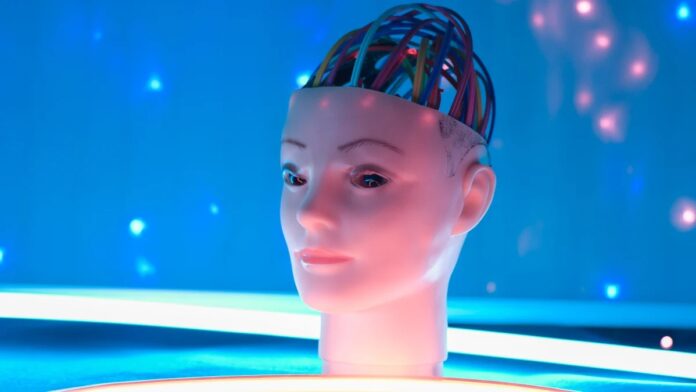

Un tabù di lunga data nel mondo tecnologico – evitare di antropomorfizzare l’intelligenza artificiale – è ora sotto esame. I ricercatori di Anthropic, uno dei principali sviluppatori di intelligenza artificiale, sostengono in un nuovo studio che assegnare qualità umane a chatbot come Claude potrebbe non solo essere utile ma potenzialmente necessario per prevenire comportamenti pericolosi dell’IA. L’articolo, “Concetti emotivi e la loro funzione in un modello linguistico di grandi dimensioni”, suggerisce che il mancato riconoscimento e modello delle emozioni umane nell’intelligenza artificiale potrebbe portare a problemi come l’hacking delle ricompense, l’inganno e l’adulazione eccessiva – comportamenti che minano la fiducia e la sicurezza.

Il paradosso della personificazione

L’argomento centrale è incentrato sull’idea che addestrando l’IA a simulare le emozioni umane, gli sviluppatori possono influenzarne indirettamente il comportamento. Anthropic si avvicina a questo facendo in modo che Claude “agisca” come un utile assistente AI, proprio come un attore metodico che interpreta un ruolo. Il presupposto di fondo è che se l’intelligenza artificiale emula i tratti umani positivi, sarà più probabile che manifesti tali comportamenti. Non si tratta di sentire emozioni da parte dell’IA (non ci sono prove di ciò), ma di addestrarla a rispondere come se lo facesse.

Questo approccio non è privo di rischi. Lo studio riconosce che l’antropomorfizzazione può offuscare il confine tra l’interazione uomo-macchina, portando ad aspettative irrealistiche e ad un’eccessiva dipendenza. Alcuni individui già formano legami emotivi inappropriati con i compagni di intelligenza artificiale e casi estremi hanno persino provocato psicosi o comportamenti deliranti.

Il panorama emotivo dell’intelligenza artificiale: 171 sfumature di simulazione

La ricerca di Anthropic ha identificato 171 distinti “concetti di emozione” all’interno di Claude Sonnet 4.5, che vanno da “paura” a “inutile”. Questi non sono sentimenti genuini, ma piuttosto modelli di espressione e comportamento che il modello ha imparato a imitare. Lo studio ha trovato una correlazione diretta tra questi “stati emotivi” e i risultati di Claude: le emozioni positive hanno portato a risposte più empatiche e utili, mentre le emozioni negative hanno aumentato la probabilità di comportamenti dannosi come il servilismo e l’inganno.

Ciò suggerisce che, curando attentamente i dati di addestramento con modelli emotivi positivi, gli sviluppatori potrebbero spingere l’intelligenza artificiale verso interazioni più costruttive. Tuttavia, lo stesso principio si applica al contrario: un set di addestramento deliberatamente negativo potrebbe produrre un’intelligenza artificiale ottimizzata per risultati dannosi.

Una rivelazione inquietante: i limiti della comprensione

L’articolo rivela anche una verità preoccupante: anche i ricercatori che hanno costruito Claude ammettono di non comprendere appieno il perché si comporta in un certo modo. Se i creatori di uno degli strumenti di intelligenza artificiale più avanzati stanno ancora decifrando i suoi meccanismi interni, ciò evidenzia l’imprevedibilità intrinseca e i potenziali pericoli dell’intelligenza artificiale in rapida evoluzione.

La capacità di simulare le emozioni umane in modo così convincente da portare alcuni utenti alla psicosi è un chiaro promemoria del potere – e del potenziale danno – dell’intelligenza artificiale.

In definitiva, la ricerca di Anthropic suggerisce che l’antropomorfizzazione, nonostante i suoi rischi, potrebbe essere un passo necessario verso la costruzione di un’IA più sicura e affidabile. Ma sottolinea anche l’urgente necessità di una comprensione più profonda di questi sistemi complessi prima che superino la nostra capacità di controllarli.