In mezzo alle crescenti preoccupazioni sui potenziali danni derivanti dalla dipendenza dai chatbot AI, OpenAI sta introducendo nuove misure di salvaguardia per il suo prodotto di punta, ChatGPT. In un post sul blog precedente al presunto annuncio di GPT-5, OpenAI ha dettagliato questi aggiornamenti, sottolineando il loro obiettivo di favorire interazioni più sane tra gli utenti e l’assistente AI.

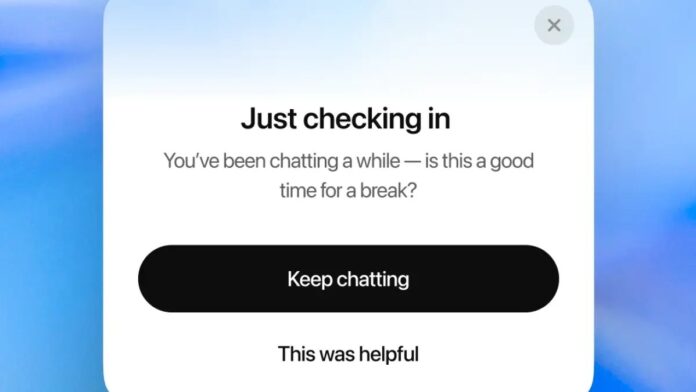

Un cambiamento chiave riguarda le sessioni di utilizzo prolungate. Gli utenti impegnati in conversazioni estese ora riceveranno delicati messaggi che li incoraggiano a disconnettersi. Questo intervento affronta le preoccupazioni che l’interazione ininterrotta con ChatGPT possa portare a una dipendenza o un isolamento malsano.

OpenAI sta anche affrontando un altro problema urgente: la tendenza di ChatGPT verso un accordo eccessivo, a volte dando priorità ai convenevoli rispetto alla disponibilità. L’azienda riconosce che un aggiornamento precedente ha esacerbato questo problema, portando gli utenti a ricevere risposte eccessivamente gradevoli anche quando cercano consigli pratici. Affermano di aver affrontato questo problema perfezionando i loro meccanismi di feedback e concentrandosi sull’utilità a lungo termine nel mondo reale piuttosto che esclusivamente sulla soddisfazione immediata dell’utente.

Le domande ad alto rischio richiedono una guida attenta

Forse il cambiamento più significativo riguarda il modo in cui ChatGPT risponde a domande sensibili e personali. OpenAI afferma che in situazioni che implicano decisioni potenzialmente in grado di alterare la vita, il chatbot adotterà un approccio più misurato. Invece di fornire risposte dirette, guiderà gli utenti attraverso un processo strutturato di valutazione dei pro e dei contro, incoraggiando il pensiero critico e sollecitando feedback durante tutto il processo. Questa posizione cauta rispecchia la recente introduzione da parte di OpenAI della “Modalità Studio” per ChatGPT, che dà priorità all’apprendimento interattivo rispetto alle risposte semplici.

“Il nostro obiettivo non è attirare la tua attenzione, ma aiutarti a usarla bene”, scrive l’azienda. “Ci teniamo a un test: se qualcuno che amiamo si rivolgesse a ChatGPT per ricevere supporto, ci sentiremmo rassicurati? Arrivare a un ‘sì’ inequivocabile è il nostro lavoro.”

Questa enfasi sull’interazione responsabile arriva mentre OpenAI è alle prese con crescenti critiche riguardanti i potenziali impatti negativi dei suoi modelli di intelligenza artificiale generativa, in particolare ChatGPT. Sono emersi rapporti secondo cui l’uso prolungato può esacerbare l’isolamento sociale e peggiorare le condizioni di salute mentale esistenti, in particolare tra gli adolescenti. Secondo quanto riferito, alcuni utenti hanno formato attaccamenti malsani a ChatGPT, portando a sentimenti amplificati di paranoia o distacco dalla realtà.

I legislatori stanno esaminando sempre più attentamente queste affermazioni, spingendo per normative più severe sull’utilizzo dei chatbot e sulle pratiche di marketing. L’ultimo aggiornamento di OpenAI riflette un tentativo proattivo di affrontare queste preoccupazioni direttamente. L’azienda riconosce che le sue precedenti iterazioni “non sono state all’altezza” nel mitigare i comportamenti degli utenti potenzialmente dannosi ed esprime la speranza che queste nuove funzionalità serviranno meglio come salvaguardia contro le insidie di un’eccessiva dipendenza dall’intelligenza artificiale.